Im Bereich des maschinellen Lernens spielen gelabelte Daten eine entscheidende Rolle bei dem Training präziser Modelle. Jedoch kann die Beschaffung von solchen Daten kostspielig und zeitaufwändig sein. Mit Semi-Supervised learning betrittst Du ein Paradigma, das das ungenutzte Potenzial großer Mengen an ungelabelten Daten neben begrenzten gelabelten Daten nutzt. Durch die nahtlose Verbindung der Vorteile von supervised und unsupervised Learning öffnet Semi-Supervised Learning Türen zu neuen Möglichkeiten und erweitert die Grenzen dessen, was erreicht werden kann. In diesem Artikel tauchen wir in die Welt des Semi-Supervised Learning ein und erforschen seine Konzepte, Techniken und realen Anwendungen. Begleite uns, während wir die Mysterien dieses leistungsstarken Ansatzes enthüllen, der das Feld des maschinellen Lernens revolutioniert hat.

Was ist Semi-Supervised Learning?

Semi-Supervised Learning ist eine Art von Machine Learning-Technik, die sowohl gelabelte als auch ungelabelte Daten kombiniert, um ein Modell zu trainieren. Das Ziel ist es, die kleine Menge an gelabelten Daten zu nutzen, um das Modell zu lenken, während die große Menge an ungelabelten Daten die Genauigkeit des Modells verbessert.

Beim Semi-Supervised learning wird das Modell zunächst mit einer kleinen Menge an gelabelten Daten trainiert, um ein grundlegendes Verständnis für das Problem aufzubauen. Das Modell wird dann verwendet, um eine große Menge an ungelabelten Daten zu kennzeichnen, und die neu gelabelten Daten werden dem Trainingssatz hinzugefügt. Dieser Prozess wird iterativ wiederholt, bis das Modell ein zufriedenstellendes Maß an Genauigkeit erreicht.

Wie funktioniert Semi-Supervised Learning?

Semi-Supervised Learning ist eine Art von Machine Learning, bei der der Algorithmus mit sowohl gelabelten als auch ungelabelten Daten trainiert wird, um seine Vorhersageleistung zu verbessern. In diesem Abschnitt werden wir besprechen, wie Semi-Supervised Learning anhand eines Beispiels zur Bildklassifikation funktioniert.

Angenommen, wir haben einen Datensatz mit Bildern von Tieren, wobei jedes Bild entweder als Katze oder Hund gelabelt ist. Wir haben eine begrenzte Anzahl von gelabelten Bildern, sagen wir 1.000, und eine viel größere Menge an ungelabelten Bildern, sagen wir 100.000. Wir möchten ein Modell erstellen, das Bilder genau als Katze oder Hund klassifizieren kann.

Beim überwachten Lernen würden wir die 1.000 gelabelten Bilder verwenden, um ein Modell wie ein Convolutional Neural Network (CNN) zu trainieren, um neue Bilder zu klassifizieren. Jedoch wäre die Leistung des Modells durch die geringe Anzahl von gelabelten Bildern begrenzt und es könnte sich möglicherweise nicht gut auf neue, unbekannte Bilder verallgemeinern.

Beim Semi-Supervised Learning kannst Du die 1.000 gelabelten Bilder zusammen mit den 100.000 ungelabelten Bildern nutzen, um die Leistung des Modells zu verbessern. Der Algorithmus wird zunächst auf den gelabelten Bildern trainiert, um die Merkmale zu lernen, die Katzen von Hunden unterscheiden. Anschließend verwendet er diese gelernten Merkmale, um die ungelabelten Bilder zu klassifizieren.

Es gibt verschiedene Ansätze zum Semi-Supervised learning, aber eine häufige Methode heißt “self-training”. Beim self-training wird das Modell auf den gelabelten Bildern trainiert und verwendet dann diese gelabelten Bilder, um die Labels der ungelabelten Bilder vorherzusagen. Das Modell wird anschließend sowohl auf den gelabelten als auch auf den neu vorhergesagten gelabelten Bildern erneut trainiert, und der Prozess wird iterativ wiederholt. Dieser Prozess lässt sich wie folgt zusammenfassen:

- Trainiere das Modell auf den gelabelten Bildern.

- Verwende das trainierte Modell, um die Labels der ungelabelten Bilder vorherzusagen.

- Füge die vorhergesagten gelabelten Bilder dem gelabelten Datensatz hinzu.

- Trainiere das Modell erneut auf der kombinierten Menge an gelabelten Bildern.

- Wiederhole die Schritte 2-4, bis Konvergenz erreicht ist.

Durch diesen Prozess kann das Modell lernen, Muster in den ungelabelten Bildern zu erkennen und seine Leistung bei der Aufgabe zu verbessern. In unserem Beispiel kann das Semi-Supervised Modell gemeinsame Merkmale von Katzen und Hunden wie Fellfarbe, Ohrform und Nasenstruktur aus den gelabelten Bildern lernen. Anschließend kann es diese Merkmale verwenden, um die Labels der ungelabelten Bilder vorherzusagen. Durch wiederholtes Training auf den vorhergesagten gelabelten Bildern kann das Modell seine Fähigkeit verbessern, zwischen Katzen und Hunden zu unterscheiden und präzisere Vorhersagen zu treffen.

Was sind die Unterschiede zwischen Machine Learning Methoden?

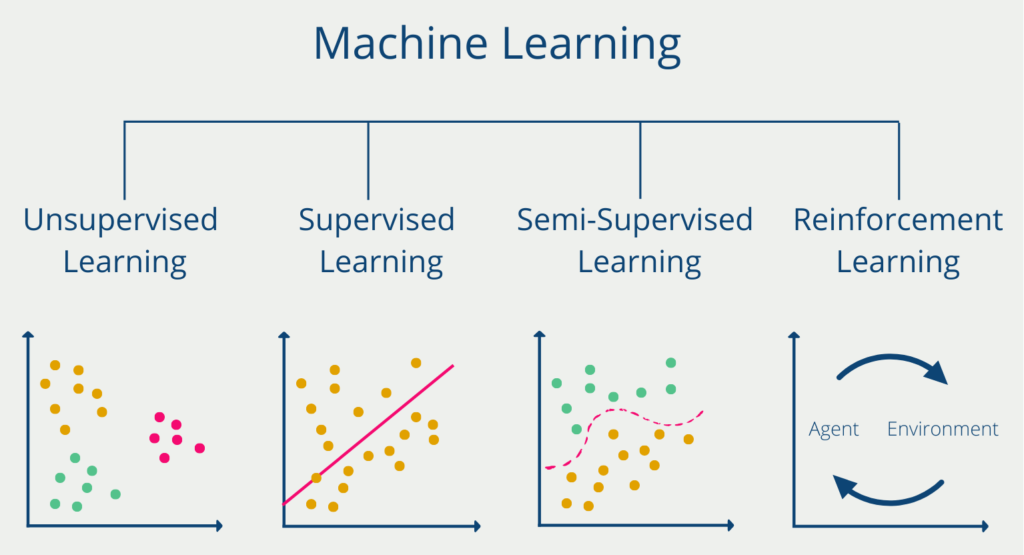

Im Bereich des Machine Learning werden insgesamt vier verschiedene Lernmethoden unterschieden:

- Beim Supervised Learning lernen Algorithmen Beziehungen anhand eines Datensatzes, der bereits das Label enthält, das das Modell vorhersagen soll. Sie können jedoch nur Strukturen erkennen und lernen, die im Trainingsdatensatz enthalten sind. Supervised-Modelle werden beispielsweise bei der Klassifizierung von Bildern verwendet. Indem sie Bilder verwenden, die bereits einer Klasse zugeordnet sind, lernen sie Beziehungen zu erkennen, die sie dann auf neue Bilder anwenden können.

- Unsupervised Learning Algorithmen lernen von einem Datensatz, der jedoch noch keine Labels hat. Sie versuchen, ihre eigenen Regeln und Strukturen zu erkennen, um die Daten in Gruppen einzuteilen, die möglichst ähnliche Eigenschaften aufweisen. Unsupervised Learning kann beispielsweise verwendet werden, wenn Du Kunden anhand gemeinsamer Merkmale in Gruppen einteilen möchtest. Dazu können beispielsweise die Bestellhäufigkeit oder der Bestellbetrag verwendet werden. Welche Merkmale das Modell jedoch verwendet, entscheidet es selbst.

- Semi-Supervised Learning ist eine Mischung aus Supervised Learning und Unsupervised Learning. Das Modell verfügt über einen relativ kleinen Datensatz mit verfügbaren Labels und einen viel größeren Datensatz mit ungelabelten Daten. Das Ziel besteht darin, Beziehungen aus der kleinen Menge an gelabelten Informationen zu lernen und diese Beziehungen im ungelabelten Datensatz zu testen, um daraus zu lernen.

- Reinforcement Learning ist ein aufregender Zweig des Machine Learning, der einem Agenten ermöglicht, in dynamischen Umgebungen zu lernen und Entscheidungen zu treffen. Im Kern folgt das Reinforcement Learning einem einfachen Prinzip: Ein Agent interagiert mit einer Umgebung, trifft Aktionen, erhält Rückmeldungen in Form von Belohnungen oder Bestrafungen und lernt, seine kumulative Belohnung im Laufe der Zeit zu maximieren. Durch den Einsatz von Techniken wie Wertiteration, Policy-Gradienten oder Deep Q-Networks lernen Reinforcement-Learning-Algorithmen iterativ optimale Strategien, indem sie die Umgebung erkunden und ausnutzen. Durch diesen kontinuierlichen Zyklus von Handeln und Lernen befähigt Reinforcement Learning Maschinen, sich anzupassen und ihre Entscheidungsfähigkeiten zu verbessern, was zu bemerkenswerten Leistungen in Bereichen wie Spielen, Robotik und autonomen Systemen führt.

Semi-Supervised Learning unterscheidet sich in mehreren Aspekten von Unsupervised und Supervised Learning:

- Gelabelte Daten: Beim Supervised Learning wird das Modell mit gelabelten Daten trainiert. Beim Unsupervised Learning wird das Modell mit ungelabelten Daten trainiert. Beim semi-supervised learning wird das Modell mit sowohl gelabelten als auch ungelabelten Daten trainiert.

- Menge an gelabelten Daten: Beim Supervised Learning benötigt das Modell eine große Menge an gelabelten Daten, um eine hohe Genauigkeit zu erreichen. Beim Unsupervised Learning benötigt das Modell keine gelabelten Daten. Beim Semi-Supervised learning reicht eine kleine Menge an gelabelten Daten aus, um eine hohe Genauigkeit zu erzielen.

- Präzision: Supervised Learning ist die präziseste der drei Techniken, da es mit gelabelten Daten trainiert wird. Unsupervised Learning ist weniger präzise, da es nicht mit gelabelten Daten trainiert wird. Semi-Supervised Learning liegt dazwischen, da es sowohl mit gelabelten als auch mit ungelabelten Daten trainiert wird.

- Skalierbarkeit: Unsupervised Learning ist hoch skalierbar, da es auf großen Mengen an ungelabelten Daten angewendet werden kann. Supervised Learning erfordert eine große Menge an gelabelten Daten, die möglicherweise schwer zu beschaffen ist. Semi-supervised learning ist in gewissem Maße skalierbar, erfordert jedoch mindestens eine kleine Menge an gelabelten Daten, um zu starten.

Welche Modelle gehören zum Semi-Supervised Learning?

Semi-Supervised Learning ist eine Art von Machine Learning, die sowohl gelabelte als auch ungelabelte Daten verwendet, um ein Modell zu trainieren. Im Gegensatz zum Supervised Learning, bei dem nur gelabelte Daten verwendet werden, und Unsupervised Learning, bei dem nur ungelabelte Daten verwendet werden, kombiniert Semi-Supervised Learning die Stärken beider Ansätze.

Verschiedene Modelle können beim Semi-Supervised Learning verwendet werden, darunter self-training, co-training, multi-view learning, generative Modelle und graphbasierte Methoden. Beim self-training wird ein Modell auf einer kleinen Menge an gelabelten Daten trainiert, um die Labels der ungelabelten Daten vorherzusagen, und die zuversichtlichsten Vorhersagen werden dem gelabelten Datensatz hinzugefügt. Das Modell wird dann auf dem erweiterten gelabelten Datensatz erneut trainiert, und der Prozess wird iterativ wiederholt, bis das gewünschte Genauigkeitsniveau erreicht ist.

Beim co-training werden mehrere Modelle auf verschiedenen Teilmengen der Merkmale trainiert. Jedes Modell wird verwendet, um die Daten für das andere Modell zu labeln, und die gelabelten Daten werden kombiniert, um die Genauigkeit zu verbessern. Beim multi-view learning werden mehrere Ansichten der Daten verwendet, wobei jede Ansicht unterschiedliche Informationen liefert, die kombiniert werden können, um die Genauigkeit zu verbessern.

Generative Modelle lernen die zugrunde liegende Verteilung der Daten, indem sie sowohl gelabelte als auch ungelabelte Daten trainieren und neue gelabelte Daten generieren, die dem Trainingsset hinzugefügt werden können. Graph-basierte Methoden erstellen einen Graphen, bei dem die Datenpunkte Knoten und die Kanten die Beziehungen zwischen den Datenpunkten darstellen. Dabei werden die gelabelten Daten verwendet, um die Labels über den Graphen auf die ungelabelten Daten zu übertragen.

Welche Anwendungen hat das Semi-Supervised Learning?

Semi-Supervised Learning hat viele potenzielle Anwendungen in verschiedenen Bereichen. Hier sind einige konkrete Beispiele:

- Bild- und Spracherkennung: Semi-Supervised Learning kann zur Verbesserung von Bild- und Spracherkennung verwendet werden. Durch die Verwendung einer kleinen Menge an gelabelten Daten kann das Modell trainiert werden, um bestimmte Objekte oder Wörter zu erkennen, während es die große Menge an ungelabelten Daten nutzt, um die Genauigkeit zu verbessern.

- Natürliche Sprachverarbeitung: Semi-Supervised Learning kann in der natürlichen Sprachverarbeitung verwendet werden, um neue Konzepte oder Entitäten mit nur wenigen gelabelten Beispielen zu lernen. Dies kann besonders nützlich in Szenarien sein, in denen ständig neue Wörter oder Konzepte eingeführt werden, wie z.B. in sozialen Medien oder Nachrichtenartikeln.

- Betrugserkennung: Die Lernmethode kann zur Erkennung von Betrug bei Finanztransaktionen verwendet werden. Indem eine kleine Menge an gelabelten Daten verwendet wird, um betrügerische Transaktionen zu identifizieren, kann das Modell die große Menge an ungelabelten Daten nutzen, um neue betrügerische Muster zu identifizieren.

Was sind die Vor- und Nachteile des Semi-Supervised Learning?

Semi-Supervised Learning hat mehrere Vorteile gegenüber Supervised und Unsupervised Learning Methoden. Einer der Hauptvorteile besteht darin, dass es das Beste aus beiden Welten nutzen kann – den gelabelten und den ungelabelten Daten. Mit gelabelten Daten kann es von klaren Beispielen lernen und genaue Vorhersagen treffen. Mit ungelabelten Daten kann es von mehr Daten lernen und besser verallgemeinern. Darüber hinaus kann Semi-Supervised Learning kosteneffizienter sein als vollständig Supervised Learning, da die Kennzeichnung großer Datenmengen teuer sein kann.

Allerdings hat Semi-Supervised Learning auch einige Nachteile. Eine der Hauptherausforderungen besteht darin, dass es eine große Menge an ungelabelten Daten erfordert, um effektiv zu sein. Wenn die Menge an ungelabelten Daten begrenzt ist, können die Leistungsgewinne möglicherweise nicht signifikant sein. Darüber hinaus können Semi-Supervised Learning Modelle komplex sein und mehr Rechenressourcen zum Trainieren erfordern als traditionelle Supervised Learning Modelle. Schließlich können Semi-Supervised Learning Modelle anfällig für Overfitting sein, wenn die Menge an gelabelten Daten zu klein ist oder das Modell zu komplex ist.

Trotz dieser Herausforderungen hat Semi-Supervised Learning in verschiedenen Anwendungen, einschließlich natürlicher Sprachverarbeitung, Computer Vision und Spracherkennung, großes Potenzial gezeigt. Mit Fortschritten im Bereich des Deep Learning und anderen verwandten Feldern ist es wahrscheinlich, dass Semi-Supervised Learning weiterhin ein wichtiger Forschungsbereich und ein nützliches Werkzeug zur Lösung realer Probleme bleibt.

Welche Herausforderungen birgt das Semi-Supervised Learning?

Das Semi-Supervised Learning stellt mehrere Herausforderungen dar, einschließlich:

- Qualität der ungelabelten Daten: Die Qualität der ungelabelten Daten kann die Leistung des Semi-Supervised Learning erheblich beeinflussen. Ungelabelte Daten von geringer Qualität können Rauschen einführen und das Modell ungenauer machen.

- Begrenzte Verfügbarkeit von gelabelten Daten: Das Semi-Supervised Learning geht davon aus, dass eine begrenzte Menge an gelabelten Daten zur Verfügung steht. In einigen Fällen kann es jedoch zeitaufwändig und teuer sein, gelabelte Daten zu erhalten.

- Domain-Adaptation: In einigen Fällen kann sich die Verteilung von gelabelten und ungelabelten Daten erheblich unterscheiden. In solchen Fällen kann das Modell möglicherweise nicht gut auf neue, unbekannte Daten verallgemeinern.

- Klassenungleichgewicht: In einigen Fällen kann die Verteilung der Klassen in den gelabelten und ungelabelten Daten unausgeglichen sein, was das Modell zu einer Voreingenommenheit zugunsten der Mehrheitsklasse führen kann.

- Modellkomplexität: Diese Lernmodelle können komplexer sein als Supervised Learning Modelle. Das Training solcher Modelle erfordert mehr Rechenressourcen, was für einige Anwendungen eine Herausforderung sein kann.

Was sind praktische Überlegungen und Tipps, um mit dem Semi-Supervised Learning zu beginnen?

Wenn du dich in die Welt des Semi-Supervised Learning begibst, gibt es mehrere praktische Überlegungen und Tipps, die du im Hinterkopf behalten solltest. Diese Richtlinien helfen dir, den Prozess zu navigieren und das Beste aus deinen gelabelten und ungelabelten Daten herauszuholen.

- Datenverarbeitung – Ausgleich von gelabelten und ungelabelten Daten: Beginne damit, die Verfügbarkeit und Qualität deiner gelabelten Daten zu bewerten. Achte auf das Verhältnis zwischen gelabelten und ungelabelten Daten, da dies den Lernprozess beeinflusst. Techniken wie aktives Lernen oder Bootstrapping können helfen, iterativ mehr Daten aus dem ungelabelten Satz zu labeln. Stelle außerdem sicher, dass sowohl gelabelte als auch ungelabelte Daten aus derselben Verteilung stammen, um eine Verzerrung zu vermeiden.

- Auswahl geeigneter Algorithmen: Erkunde anschließend verschiedene Semi-Supervised Learning-Algorithmen, die für dein spezifisches Problemfeld geeignet sind. Mache dich mit Techniken wie Self-Training, Co-Training oder generativen Modellen vertraut. Es ist wichtig, die Annahmen und Grenzen jedes Algorithmus zu verstehen, um eine informierte Wahl zu treffen, die mit deinem Datensatz und den Anforderungen des Problems übereinstimmt. Berücksichtige auch die Skalierbarkeit des Algorithmus, insbesondere wenn du es mit größeren Datensätzen zu tun hast.

- Umgang mit Verzerrungen und Labeling-Fehlern: Achte auf potenzielle Verzerrungen in deinen gelabelten Daten und wie sie den Lernprozess beeinflussen können. Mindere Verzerrungen, indem du Techniken wie Debiasing-Algorithmen einsetzt oder sorgfältig repräsentative Beispiele auswählst. Berücksichtige außerdem potenzielle Labeling-Fehler, indem du die Qualität der gelabelten Daten bewertest, die Expertise der Annotatoren berücksichtigst und möglicherweise Fehlerkorrekturcodes anwendest.

- Regularisierung und Modellkomplexität: Overfitting ist ein Problem, insbesondere bei der Arbeit mit begrenzten gelabelten Daten. Verwende Regularisierungstechniken, um dieses Problem anzugehen. Experimentiere mit verschiedenen Methoden wie L1- oder L2-Regularisierung, um das richtige Gleichgewicht zwischen dem Einfluss von gelabelten und ungelabelten Daten zu finden und zu verhindern, dass das Modell zu komplex wird.

- Evaluation und Leistungsmetriken: Wähle bei der Bewertung deines Semi-Supervised Learning-Modells geeignete Leistungsmetriken, die mit deiner spezifischen Aufgabe und deinem Problemfeld übereinstimmen. Klassifikationsgenauigkeit, Präzision, Recall oder F1-Score sind gängige Metriken. Verwende Kreuzvalidierungstechniken, um eine konsistente Evaluation sicherzustellen. Vergleiche außerdem die Leistung deines Semi-Supervised Learning-Ansatzes mit traditionellen Supervised oder Unsupervised Methoden, um Einblicke in dessen Effektivität zu gewinnen.

- Integration von Domänenwissen: Nutze Domänenwissen, um den Semi-Supervised Learning-Prozess zu lenken. Die Integration von Expertenregeln oder -beschränkungen in die Lernalgorithmen kann die Leistung und Interpretierbarkeit verbessern. Erkunde Möglichkeiten, das Semi-Supervised Learning mit Transfer Learning oder Domänenanpassungstechniken zu kombinieren, um eine bessere Verallgemeinerung zu erreichen.

Denke daran, dass diese praktischen Überlegungen und Tipps als Ausgangspunkt dienen sollen. Jeder Datensatz, jedes Problemfeld und alle verfügbaren Ressourcen sind einzigartig, daher sind Experimente und Iteration entscheidend. Indem du deine Vorgehensweise entsprechend deinen spezifischen Umständen anpasst und verfeinerst, kannst du die Kraft des Semi-Supervised Learning nutzen, um wertvolle Erkenntnisse aus ungelabelten Daten zu gewinnen.

Das solltest Du mitnehmen

- Semi-supervised Learning ist ein leistungsfähiger Ansatz für maschinelles Lernen, der gekennzeichnete und nicht gekennzeichnete Daten kombiniert, um die Genauigkeit zu verbessern.

- Beim Semi-Supervised Learning können mehrere Modelle verwendet werden, darunter Self-Training, Co-Training, Multi-View-Learning, generative Modelle und graphbasierte Methoden.

- Welches Modell verwendet wird, hängt von der jeweiligen Problemstellung und den verfügbaren Daten ab.

- Semi-Supervised Learning ist besonders nützlich, wenn markierte Daten begrenzt oder teuer zu beschaffen sind.

- Es hat viele Anwendungen, unter anderem in der Verarbeitung natürlicher Sprache, im Computersehen und in der Spracherkennung.

- Die Forschung im Bereich des Semi-Supervised Learnings wird fortgesetzt, und es werden neue Modelle und Techniken entwickelt, um die Genauigkeit und Effizienz zu verbessern.

Was ist Representation Learning?

Entdecken Sie die Leistungsfähigkeit des Representation Learnings: Erforschen Sie Anwendungen, Algorithmen und Auswirkungen.

Was ist Manifold Learning?

Entdecken Sie die Welt des Manifold Learning - Ein tiefer Einblick in die Grundlagen, Anwendungen und die Programmierung.

Was ist die Grid Search?

Optimieren Sie Ihre Modelle für maschinelles Lernen mit Grid Search. Erforschen Sie die Abstimmung von Hyperparametern mit Python.

Was ist die Lernrate?

Entfalten Sie die Kraft der Lernraten beim maschinellen Lernen: Tauchen Sie ein in Strategien, Optimierung und Feinabstimmung für Modelle.

Was ist die Random Search?

Optimieren Sie Modelle für maschinelles Lernen: Lernen Sie, wie die Random Search Hyperparameter effektiv abstimmt.

Was ist die Lasso Regression?

Entdecken Sie die Lasso Regression: ein leistungsstarkes Tool für die Vorhersagemodellierung und die Auswahl von Merkmalen.

Andere Beiträge zum Thema Semi-Supervised Learning

Scikit-Learn hat einen interessanten Artikel über Semi-Supervised Learning geschrieben.

Niklas Lang

Seit 2020 bin ich als Machine Learning Engineer und Softwareentwickler tätig und beschäftige mich leidenschaftlich mit der Welt der Daten, Algorithmen und Softwareentwicklung. Neben meiner Arbeit in der Praxis unterrichte ich an mehreren deutschen Hochschulen, darunter die IU International University of Applied Sciences und die Duale Hochschule Baden-Württemberg, in den Bereichen Data Science, Mathematik und Business Analytics.

Mein Ziel ist es, komplexe Themen wie Statistik und maschinelles Lernen so aufzubereiten, dass sie nicht nur verständlich, sondern auch spannend und greifbar werden. Dabei kombiniere ich praktische Erfahrungen aus der Industrie mit fundierten theoretischen Grundlagen, um meine Studierenden bestmöglich auf die Herausforderungen der Datenwelt vorzubereiten.